Definition

Entropi (översatt från antika grekiska – tur, transformation) är ett mått, graden av oordning (kaos) i alla system. Används i följande exakta och naturvetenskapliga:

- I matematik betyder det att hitta logaritmen för antalet tillgängliga systemtillstånd;

- Inom statistisk vetenskap, det probabilistiska värdet av uppkomsten av alla makroskopiska tillstånd i systemet;

- I termodynamik (fysik), graden av irreversibel spridning av energi, dvs. standardvärdet på dess förluster, som är oundvikliga när en varmare kropp interagerar med en kallare;

- Inom datavetenskap betyder det systemets informationskapacitet. Ett intressant faktum är följande: Claude Shannon (grundaren av denna term i informationsteori) tänkte ursprungligen kalla entropiinformation.

Nästan komplicerat

Entropi är ett begrepp som används inom mer än ett område av mänsklig aktivitet, så dess definitioner kan vara något vaga. Denna term återspeglar ett värde och dess essens kan tas isär med enkla exempel. Entropi är graden av oordning, graden av osäkerhet och oordning.

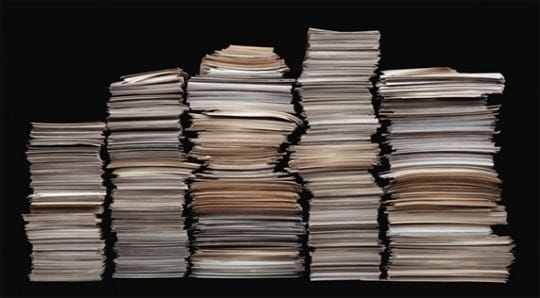

Hög entropi kan visualiseras som en gata med spridda pappersrester. Om papperen staplas snyggt i en hög, beställs systemet och entropin är låg. Entropivärdena måste sänkas, och för detta måste du spendera mycket tid, limma papperen bit för bit och lägg dem i en hög.

Om entropin i ett slutet system äger rum är allt här också enkelt. Ett stängt system kan föreställas som en stängd garderob, om saker är spridda i den, är det omöjligt att påverka dem från utsidan, och kaos i garderoben kommer att vara närvarande under lång tid.

Med tiden kommer saker att brytas ner, och detta kommer att leda till ordning, men saker måste sönderdelas under lång tid, till exempel tar det 5 år för en ullstrumpa och cirka 40 år för läderskor. I det här exemplet fungerar garderoben som ett isolerat system, och nedbrytningen av saker i den är att ordna saker i strukturerna.

Det minsta är entropin, som rör makroskopiska föremål, de kan observeras med blotta ögat. När det gäller de högre indikatorerna har de ofta ett vakuum.

Ursprungshistoria

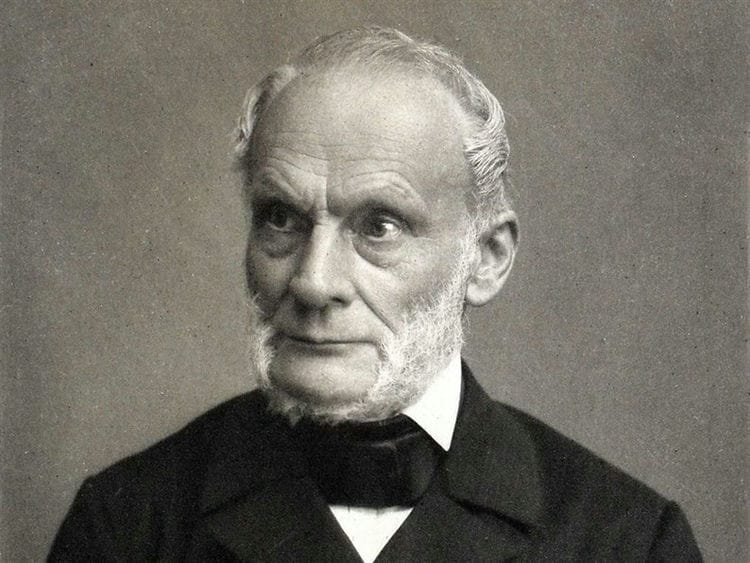

För första gången introducerades begreppet entropi under en tid av utvecklingen av termodynamik, när behovet uppstod för att studera de processer som förekommer i termodynamiska kroppar. År 1865 beskrev en fysiker från Tyskland, Rudolf Clausius, med denna term tillståndet i systemet där värme har förmågan att omvandlas till andra typer av energi (mekanisk, kemisk, ljus, etc.).

Ökningen av entropi orsakas av tillströmningen av termisk energi till systemet och är associerad med temperaturen vid vilken detta tillströmning sker. Behovet av detta värde berodde på att all fysik bygger på idealisering av abstrakta objekt (idealisk pendel, enhetlig rörelse, massa, etc.).

I vardaglig mening är entropi graden av kaos och osäkerhet i systemet: ju mer ordning i systemet och ju mer dess element underordnas någon ordning, desto mindre entropi.

Exempel: Ett skåp är ett specifikt system. Om allt finns på det, är entropin mindre. Om alla saker är utspridda och inte finns i hyllorna, blir det följaktligen större.

Den termiska funktionen av entalpi är nära besläktad med denna term – den karakteriserar tillståndet för ett termodynamiskt system i ett tillstånd av jämvikt när man väljer ett antal oberoende variabler, såsom tryck, entropi och antalet partiklar.

Motsatsen till entropi kallas extropi.

Typer av entropier

Termen används inom termodynamik, ekonomi, informationsteori och till och med sociologi. Vad definierar han inom dessa områden?

I fysikalisk kemi (termodynamik)

Huvudpostulatet för termodynamik om jämvikt: alla isolerade termodynamiska system kommer till ett jämviktsläge över tiden och kan inte komma ut ur det spontant. Det vill säga, varje system strävar efter ett jämviktstillstånd för det. Och när vi talar i mycket enkla termer kännetecknas ett sådant tillstånd av oordning.

Huvudpostulatet för termodynamik om jämvikt: alla isolerade termodynamiska system kommer till ett jämviktsläge över tiden och kan inte komma ut ur det spontant. Det vill säga, varje system strävar efter ett jämviktstillstånd för det. Och när vi talar i mycket enkla termer kännetecknas ett sådant tillstånd av oordning.

Entropi är ett mått på oordning. Hur identifierar du en röra? Ett sätt är att tilldela varje tillstånd antalet alternativ som det tillståndet kan realiseras med. Och ju fler sådana sätt att implementera, desto större blir entropiens värde. Ju mer organiserat ett ämne (dess struktur), desto mindre osäkerhet (slumpmässighet).

Det absoluta värdet av entropi (S abs.) Är lika med energiförändringen för ett ämne eller system under värmeöverföring vid en given temperatur. Dess matematiska värde bestäms av värdet på värmeöverföringen (Q) dividerat med den absoluta temperaturen (T) vid vilken processen äger rum: S abs. Q / T. Detta betyder att S abs när du överför en stor mängd värme. kommer att öka. Samma effekt kommer att observeras vid värmeöverföring vid låga temperaturer.

I ekonomi

Ekonomi använder ett sådant begrepp som entropikoefficienten. Med hjälp av denna koefficient undersöks förändringen av marknadskoncentrationen och dess nivå. Ju högre koefficientvärdet är, desto högre blir den ekonomiska osäkerheten och följaktligen minskar sannolikheten för att monopolet uppstår. Koefficienten hjälper till att indirekt bedöma de fördelar som företaget förvärvar till följd av möjliga monopolaktiviteter eller förändringar i marknadskoncentrationen.

I statistisk fysik eller informationsteori

Informationsentropi (osäkerhet) är ett mått på ett bestämt systems oförutsägbarhet eller osäkerhet. Detta värde hjälper till att bestämma graden av slumpmässighet hos experimentet eller händelsen som genomförs. Ju mer antal tillstånd som systemet kan vara i, desto större blir osäkerhetens värde. Alla processer för att beställa systemet leder till framväxten av information och minskningen av informationsosäkerheten.

Med hjälp av informationsförutsägbarhet är det möjligt att identifiera en sådan kanalkapacitet som säkerställer tillförlitlig överföring av information (i ett system med kodade symboler). Och du kan också delvis förutsäga upplevelsens eller händelsens gång, dela upp dem i deras komponenter och beräkna osäkerhetsvärdet för var och en av dem. Denna metod för statistisk fysik hjälper till att avslöja sannolikheten för en händelse. Med hjälp kan du dechiffrera den kodade texten genom att analysera sannolikheten för symbolernas utseende och deras entropiindex.

Det finns sådant som språkets absoluta entropi. Detta värde uttrycker den maximala mängden information som kan överföras till en enhet på detta språk. I detta fall tas symbolen för alfabetet för språket (bit) som en enhet.

I sociologi

Här är entropi (informationsosäkerhet) ett kännetecken för samhällets (system) avvikelse eller dess länkar från det accepterade (referens) tillståndet, och detta manifesterar sig i en minskning av systemets effektivitet och utveckling, försämring av själv -organisation. Ett enkelt exempel: anställda i ett företag är så belastade med arbete (utför ett stort antal rapporter) att de inte har tid att ägna sig åt sin huvudaktivitet (att utföra kontroller). I detta exempel kommer måttet på olämplig användning av arbetsresurser av ledningen att vara informationsosäkerhet.

Hur entropi manifesterar sig i våra liv

Med hjälp av entropi kan du förklara många obegripliga och överraskande fakta, till exempel:

Varför är vårt liv så extraordinärt

Föreställ dig människokroppen. Atomerna som utgör kroppen kunde ha vikats till ett nästan oändligt antal varianter och inte skapa någon form av liv. Ur matematikens synvinkel är sannolikheten för vår existens väldigt liten. Och ändå finns vi.

I ett universum där entropi styr allt är livets existens med en så tydlig, stabil organisation fantastisk.

Varför vi älskar konst och skönhet

Entropi kan förklara varför konst och skönhet verkar så estetiskt för oss. Konstnären skapar en speciell form av ordning och symmetri som universum sannolikt aldrig skulle ha genererat på egen hand. Antalet vackra kombinationer är mycket mindre än det totala antalet alla kombinationer. Skönhet är en sällsynthet i ett universum fullt av oordning. Därför är ett symmetriskt ansikte sällsynt och vackert, eftersom det finns ojämförligt mer asymmetriska alternativ.

Varför idealiska förhållanden för dig själv bör inte hittas utan skapas

Var och en av oss har våra egna talanger, färdigheter och intressen. Men samhället och kulturen som vi lever i skapades inte specifikt för oss. Med entropi i åtanke, överväg vilka chanser att miljön där du växte upp är idealisk för att släppa lös dina talanger?

Det är extremt osannolikt att livet skapar en situation för dig som passar perfekt för dina förmågor. Troligtvis kommer du att befinna dig i en position som inte riktigt matchar dina färdigheter och behov.

Vi beskriver vanligtvis ett sådant tillstånd som ”out of place”, ”out of their element.” Naturligtvis är det under sådana förhållanden mycket svårare att uppnå framgång, att vara användbar, att vinna. När vi vet detta måste vi själva skapa ideala levnadsförhållanden för oss själva. Svårigheter i livet uppstår inte för att planeterna är uppställda så och inte för att några högre krafter har konspirerat mot dig. Det är bara lagen om entropi på jobbet. Det finns många fler tillstånd av oordning än ordnade. Med detta i åtanke är det inte förvånande att det finns problem i livet utan att vi kan lösa dem.

Ekvation och beräkning av entropi

Det finns flera sätt att beräkna entropi. Men de två vanligaste ekvationerna avser reversibla termodynamiska och isotermiska processer (med konstant temperatur).

Entropi och värmedöd i universum

Vissa forskare förutspår att universums entropi kommer att öka i en sådan utsträckning att det skapar ett system som inte kan fungera. Och bara värmeenergi finns kvar. Universum, säger de, kommer att dö av värmedöd.

Men andra forskare bestrider teorin om värmedöd. De hävdar att universum som ett system rör sig längre och längre bort från entropi. Även om entropin inuti några av dess inre regioner

ökar.

Andra ser universum som en del av ett ännu större system. Ytterligare andra säger att de möjliga tillstånden inte har lika sannolikhet. Därför är de vanliga ekvationerna för beräkning av entropi irrelevanta.

De vanligaste formuleringarna av entropi inom fysik

Många kända fysiker har försökt förklara begreppet entropi på ett tillgängligt sätt för vanliga människor. Låt oss lyfta fram de tre mest kända formuleringarna i förklaringen.

Clausius uttalande

Att värma en kropp med högre temperatur är inte möjlig med en kropp med lägre temperatur.

Det ser till exempel ut så här – du kan sätta en vattenkokare med vatten på en isbit (a priori, vattentemperaturen är högre än istemperaturen), men du kan inte vänta tills vattnet kokar. Även om termodynamikens första två början inte förnekar denna möjlighet.

Thomsons formulering

I ett slutet system är en process omöjlig, vars enda resultat skulle vara arbete på grund av värmeenergi från någon kropp.

Boltzmanns uttalande

En minskning av entropin i ett slutet system är omöjligt.

Denna formulering orsakar mycket kontroverser, även om allt är intuitivt klart. Kaos kommer att växa i en övergiven bostad – damm kommer att sätta sig, vissa saker faller sönder. Du kan ordna saker, men bara genom att använda extern energi, det vill säga ett rengöringsarbete.

Problemet är att universum i moderna koncept är ett slutet system. Det bildades någonstans för 14-15 miljarder år sedan. Under denna tid skulle dess entropi leda till att galaxerna upplöstes, stjärnorna gick ut och inga nya stjärnor skulle visas i princip. Men vår sol är inte mer än 5 miljarder år gammal, och universum som helhet har inte kommit i ett tillstånd av kaos.

Entropi: avhandling och exempel

Ett exempel. T9-program. Om ett ord innehåller ett litet antal skrivfel, kommer programmet lätt att känna igen ordet och föreslå att det ersätts. Ju fler skrivfel, desto mindre information kommer programmet att ha om ordet som skrivs in. Följaktligen kommer en ökad förvirring att leda till en ökad informationsosäkerhet, och tvärtom, ju mer information desto mindre osäkerhet.

Exempel. Tärningar. Det finns bara ett sätt att kasta ut en kombination av 12 eller 2: 1 plus 1 eller 6 plus 6. Och det maximala antalet vägar är 7 (har 6 möjliga kombinationer). Oförutsägbarheten i genomförandet av nummer sju är störst i detta fall.

- I allmänhet kan entropi (S) förstås som ett mått på energifördelning. Vid ett lågt värde på S koncentreras energin och vid ett högt värde fördelas den kaotiskt.

Exempel. H2O (känt för allt vatten) i dess flytande tillstånd av aggregering kommer att ha större entropi än i fast ämne (is). Eftersom i en kristallin fast substans upptar varje atom en viss position i kristallgitteret (ordning) och i flytande tillstånd har atomer inte vissa fasta positioner (störning). Det vill säga en kropp med ett styvare arrangemang av atomer har ett lägre entropivärde (S). Vit diamant utan föroreningar har det lägsta S-värdet jämfört med andra kristaller.

Exempel. Molekylen finns i ett kärl som har en vänster och en höger sida. Om det inte är känt i vilken del av kärlet molekylen finns, kommer entropin (S) att bestämmas av formeln S = S max = k lgW, där k är antalet implementeringsmetoder, W är antalet delar av fartyget. Information i detta fall kommer att vara lika med noll I = I min = 0. Om det är exakt känt i vilken del av kärlet molekylen är belägen, är S = S min = k ln1 = 0 och I = I max = log 2 W. Ju mer information desto lägre är värdet på informationsosäkerheten .

Exempel. Ju högre ordning på skrivbordet, desto mer information kan du lära dig om de saker som finns på det. I det här fallet minskar beställningen av objekt entropin för ”skrivbordssystemet”.

Exempel. Det finns mer information om klassen under lektionen än under pausen. Entropin i lektionen är nedan, eftersom eleverna sitter ordentligt (mer information om varje elevs plats). Och under pauser förändras elevernas disposition kaotiskt, vilket ökar deras entropi.

Exempel. När en alkalimetall reagerar med vatten frigörs väte. Väte är en gas. Eftersom gasmolekyler rör sig kaotiskt och har hög entropi inträffar den aktuella reaktionen med en ökning av dess värde.

Från vardagen:

- När vi skriver sms-meddelanden på en mobiltelefon använder vi ofta T9-programmet. Ju färre fel i ordet vi skriver, desto lättare blir det att känna igen det av programmet och desto snabbare kommer det att ersätta oss. Slutsats: ju mer förvirring, desto större informationsosäkerhet.

- När vi kastar två tärningar när vi spelar tärningar finns det bara ett sätt att kasta en kombination av 2 eller 12 (1 och 1, 6 och 6). Det maximala antalet sätt att rulla ut nummer 7 (6 möjliga kombinationer). Oförutsägbarheten i detta fall är maximal.

- Det finns mer information om antalet elever under lektionen än under pausen. Eftersom varje elev sitter i sin lektion i lektionen är entropin lägre. Utanför klassrummet kännetecknas skolbarns rörelse av kaos, vilket leder till en ökning av entropins värde.

- Om du städar upp skrivbordet, placerar föremål på deras platser, kan du få mer information om det här eller det andra föremålet på det. Ordningen på saker på skrivbordet minskar mängden entropi.

Viktig! Allt som omger oss tenderar att öka entropin. En person har för avsikt att få maximal mängd information från omvärlden. Alla teoretiska riktningar i studien av entropi (inom fysik, kemi, ekonomi, matematik, sociologi) syftar till att skapa en balans (balans) mellan människors avsikter och önskemål och de naturliga processerna som förekommer i naturen.

Entropi: vad är det med enkla ord?

Det ryska språket, som alla andra, förändras ständigt under påtryckningar av ständig teknisk låntagning och samarbete med andra stater. Tack vare detta är vårt språk rikt på olika främmande språklån.

Ett av de relativt nya orden på ryska var ordet ”entropi”, som många av oss stötte på, men inte alla förstår vad det egentligen betyder.

Vad är entropi i enkla ord

Oftast finns ordet ”entropi” naturligtvis i klassisk fysik. Detta är ett av de svåraste begreppen i denna vetenskap, därför har studenter vid fysikuniversitet ofta problem med uppfattningen av denna term.

Detta är en mycket specifik koordinat – Ryska federationens huvudstad – Moskva är dock en ganska stor stad, så du vet fortfarande inte exakt information om min plats. Men när jag berättar att mitt, till exempel, postnummer, kommer entropin om mig, som ett objekt, att minska.

Detta är inte en helt exakt analogi, så vi kommer att ge ytterligare ett exempel för förtydligande. Låt oss säga att vi tar tio sexsidiga tärningar. Låt oss kasta dem alla i tur och ordning, och då kommer jag att berätta summan av de tappade indikatorerna – trettio.

Baserat på summan av alla resultat kommer du inte att kunna säga säkert vilken siffra och vilken dör som föll ut – du har helt enkelt inte tillräckligt med data för detta. I vårt fall kommer varje sänkt siffra på fysikernas språk att kallas en mikrostat, och en mängd lika med trettio, i samma fysiska dialekt, kommer att kallas en makrostat.

Om vi beräknar hur många möjliga mikrostater tre dussin kan ge oss totalt, kommer vi till slutsatsen att deras antal når nästan tre miljoner värden. Med hjälp av en speciell formel kan vi beräkna entropiindex i detta probabilistiska experiment – sex och ett halvt.

Varifrån kom hälften, kanske du frågar? Denna bråkdel visas på grund av det faktum att när vi numrerar i den sjunde ordningen kan vi bara använda tre siffror – 0, 1 och 2.

Det moderna ordet ”entropi” har grekiska rötter, därför kallas det ofta ”kaosmåttet” på grund av översättningen. Låt oss säga att du bestämmer dig för att ha en fest i din lägenhet i anledning av din lilla dotters födelsedag.

De städade hela lägenheten, tvättade golv och fönster, tvättade disken och lade sedan alla diskar vackert och elegant på bordet. Det ursprungliga hushållskaoset i din lägenhet har minskat avsevärt, därför har ditt hus blivit ett system med låg entropi.

Entropi i universum

Enligt prognoserna från astrofysiker är ett av alternativen för universums utveckling värmedöd.

Vårt universum är (föreställ dig hur framsynta de forntida grekerna var i detta avseende) rent kaos, där något ständigt händer: stjärnor föds och dör, nya galaxer bildas, kort sagt, skönhet! I ett bra ögonblick når universums entropi sitt maximum och det kommer helt enkelt inte att hända något i det. Så mycket för döden från ledighet.

Kaos genomsyrar hela kosmos, hela vår natur, ner till atomer och elementära partiklar. Allt är i konstant rörelse och interaktion, som en perfekt bearbetad mekanism. Och alla dessa processer styrs av lagar som vi, eländiga människor, kan uttrycka på inte mindre vackert matematiskt språk.

Men hur, med en sådan nivå av entropi (det vill säga kaos) i universum, kunde någonting alls uppstå? Svaret på denna fråga är extremt enkelt. All materia överför nivån på dess entropi till sin egen miljö, allt den kan nå.

Till exempel, för att reglera nivån av entropi på jorden, förser en stjärna med namnet solen oss ständigt med energi, som den producerar på grund av en oavbruten termonukleär reaktion på dess yta.

Om vår planet var ett slutet system, skulle enligt den andra lagen om termodynamik, entropin inuti den bara öka, men som du redan förstod, tillåter solen oss att hålla nivån på jordens entropi normal.

Entropi och kaos genomsyrar allt som omger oss och även det som finns i oss. I gaser och vätskor spelar entropi en nyckelroll, även våra ögonblickliga önskningar och impulser är faktiskt inget annat än en produkt av universellt universellt kaos.

Det är inte svårt att än en gång komma till den vackraste slutsatsen: Universum, oavsett hur stort det än kan vara, är en samling av ett oändligt antal partiklar i de mest varierande storlekar och inte mindre olika egenskaper.

Allt i det, från en elementär boson till Alpha Centauri och hela galaxer, är ansluten med osynliga trådar. Sådana upptäckter av fysiker slår inte bara i deras komplexitet utan också i deras skönhet.

Det verkar som om de vanliga matematiska och fysiska formlerna på brädorna hos orakade eftertänksamma män med glasögon är nyckelfaktorer för vår kunskap om oss själva och oss själva och vår plats i det stora universum.

Vi hoppas att den här artikeln hjälpte dig att klargöra vad entropi egentligen är, i vilka fall detta ord används, och också vad upptäckten av denna indikator ledde forskare och filosofer till.

Vem vet, kanske att läsa den här artikeln kommer att inspirera dig att målmedvetet studera denna underbara vetenskap – fysik. På ett eller annat sätt är det mycket viktigt för en modern person att vara intresserad av vetenskap, åtminstone för sin egen utveckling.

Till sist

Om vi kombinerar allt ovanstående, visar det sig att entropi är ett mått på störningen eller osäkerheten hos systemet och dess delar. Ett intressant faktum är att allt i naturen tenderar till maximal entropi, och människan – till maximal information.

Källor som används och användbara länkar om ämnet: https://advi.club/psihologiya-i-obshhestvo/183-entropiya-prostymi-slovami.html https://obraz-ola.ru/prochee/razbiraemsya-chto-takoe- entropiya .html https://tvercult.ru/nauka/entropiya-chto-eto-takoe-obyasnenie-termina-prostyimi-slovami https://Lifehacker.ru/entropy/ https://zen.yandex.ru/media/ alivespace / chto-takoe-entropiia-5d98e1ab43863f00b19f8f80 https://zen.yandex.ru/media/popsci/chto-takoe-entropiia-i-kak-ona-sviazana-s-materiei-i-energiei-5c55ad170280ed00ae : obrabezov. / nauka / entropiya-chto-eto-takoe-obyasnenie-termina-prostymi-slovami.html